Weitreichende Regeln für den Einsatz von künstlicher Intelligenz (KI) werden in der Europäischen Union (EU) voraussichtlich 2025 oder 2026 in Kraft treten. Der Rat der 27 EU-Mitgliedstaaten und das Europäische Parlament haben kürzlich verschiedene Änderungsanträge zum Vorschlag der Europäischen Kommission vom April 2021 zur Regulierung "risikoreicher" Anwendungen von KI eingebracht und arbeiten nun an einem gemeinsamen Text. Je nach Dauer dieser Gespräche könnten beide EU-Gremien das KI-Gesetz 2023 oder 2024 verabschieden und die so genannte horizontale Verordnung - die alle Bereiche der KI-Nutzung abdeckt, anstatt sich auf bestimmte Bereiche zu konzentrieren - zwei Jahre später in Kraft treten.

Das bedeutet, dass viele Details der weltweit umfassendsten KI-Verordnung noch im Fluss sind. Aber die Grundzüge sind klar - ebenso wie die Bereiche, in denen der Teufel noch im Detail stecken könnte. Das KI-Gesetz schafft einen Rahmen für die Einhaltung der Vorschriften, der für Entwickler von KI-Anwendungen, die die EU als risikoreich einstuft, mehr (Papier-)Arbeit und höhere Kosten bedeuten wird - unabhängig davon, ob sie in der EU ansässig sind oder nur Kunden in der EU bedienen. Auch wenn die Kommission schätzt, dass nur 5-15 Prozent der Anwendungen als hochriskant eingestuft werden, werden größere Akteure weniger Probleme haben als kleinere, die keine Anwälte im Haus oder auf Abruf haben.

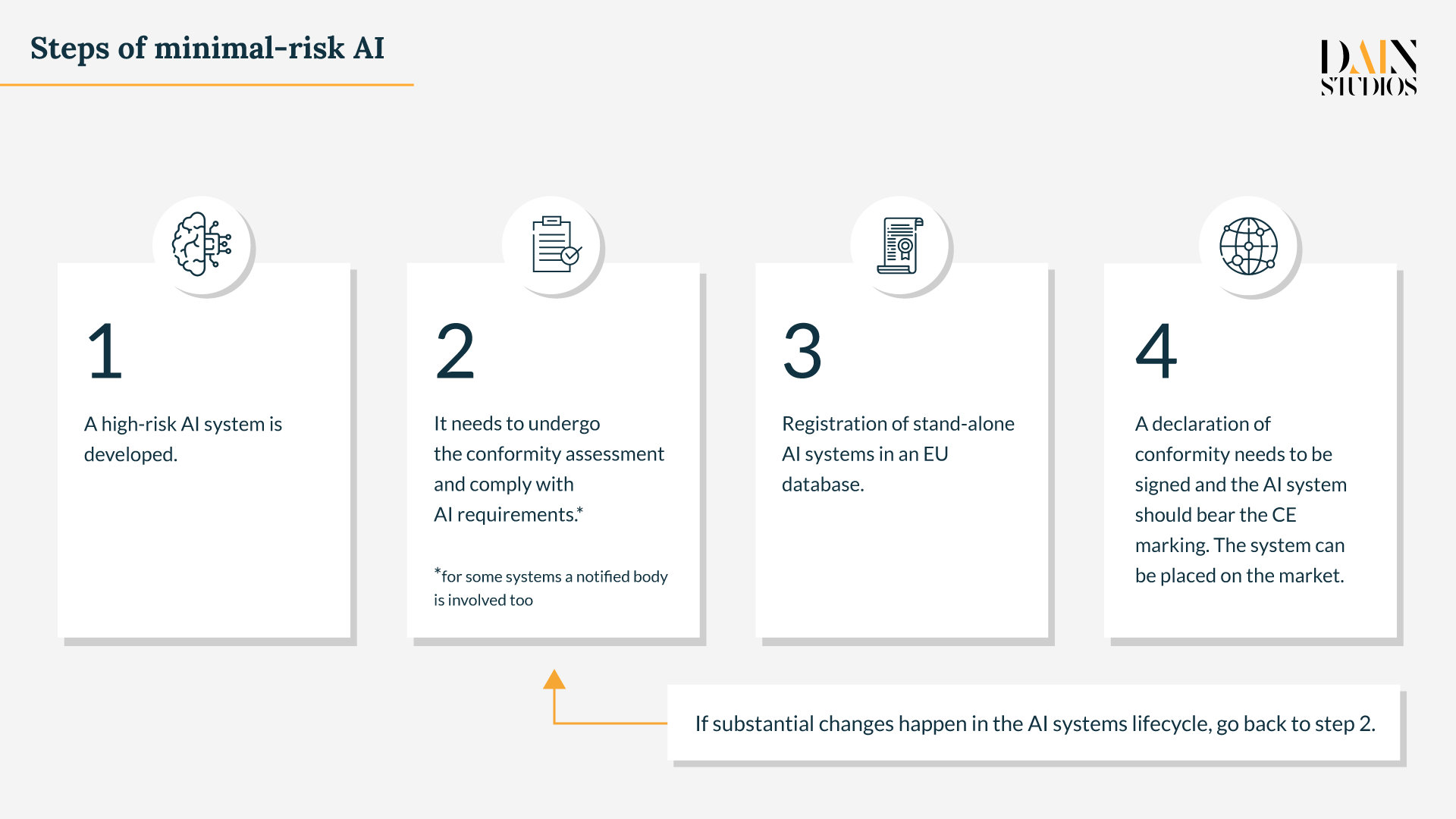

Der Verordnungsentwurf der Kommission definiert zum Beispiel jedes Unternehmen, das ein KI-System entwickelt, als "KI-Anbieter" - und damit auch jedes Unternehmen, das ein KI-System nur für den internen Gebrauch erstellt. Möchte das Unternehmen diese Anwendung für Personalmanagement, Bildung oder andere sogenannte Hochrisikoanwendungen nutzen, müsste es vorher eine Konformitätsbewertung durchführen und danach die Leistung überwachen. Einem unwissenden "KI-Anbieter", der sich dieser Vorschrift nicht bewusst ist, droht ein Bußgeld (siehe unten), wenn er nicht das obligatorische CE-Zeichen als Nachweis für die Konformität des Produkts mit den Gesundheits-, Sicherheits- und Umweltnormen der EU erworben hat.

Dieser potenzielle rechtliche Fallstrick wird durch die von der Kommission gewählte, notwendigerweise sehr weit gefasste Definition von KI noch verschärft. Abgesehen vom maschinellen Lernen betrachtet sie jede Software, die seit langem etablierte Expertensysteme und statistische Modelle verwendet, als Bestandteil der KI. Das bedeutet, dass selbst einfache Formen von Code in den Geltungsbereich des KI-Gesetzes fallen könnten - und eine Konformitätserklärung von einer dritten Partei erfordern würden, wenn sie in Hochrisikobereichen eingesetzt werden. Diese und andere Probleme des Verordnungsentwurfs wurden jedoch erkannt - und man hofft nun, dass die EU-Mitgliedstaaten und das Europäische Parlament sich um die Bereiche kümmern werden, die Aufmerksamkeit erfordern.

Auch wenn die Details noch im Fluss sind, sind die Grundzüge des AI-Gesetzes klar

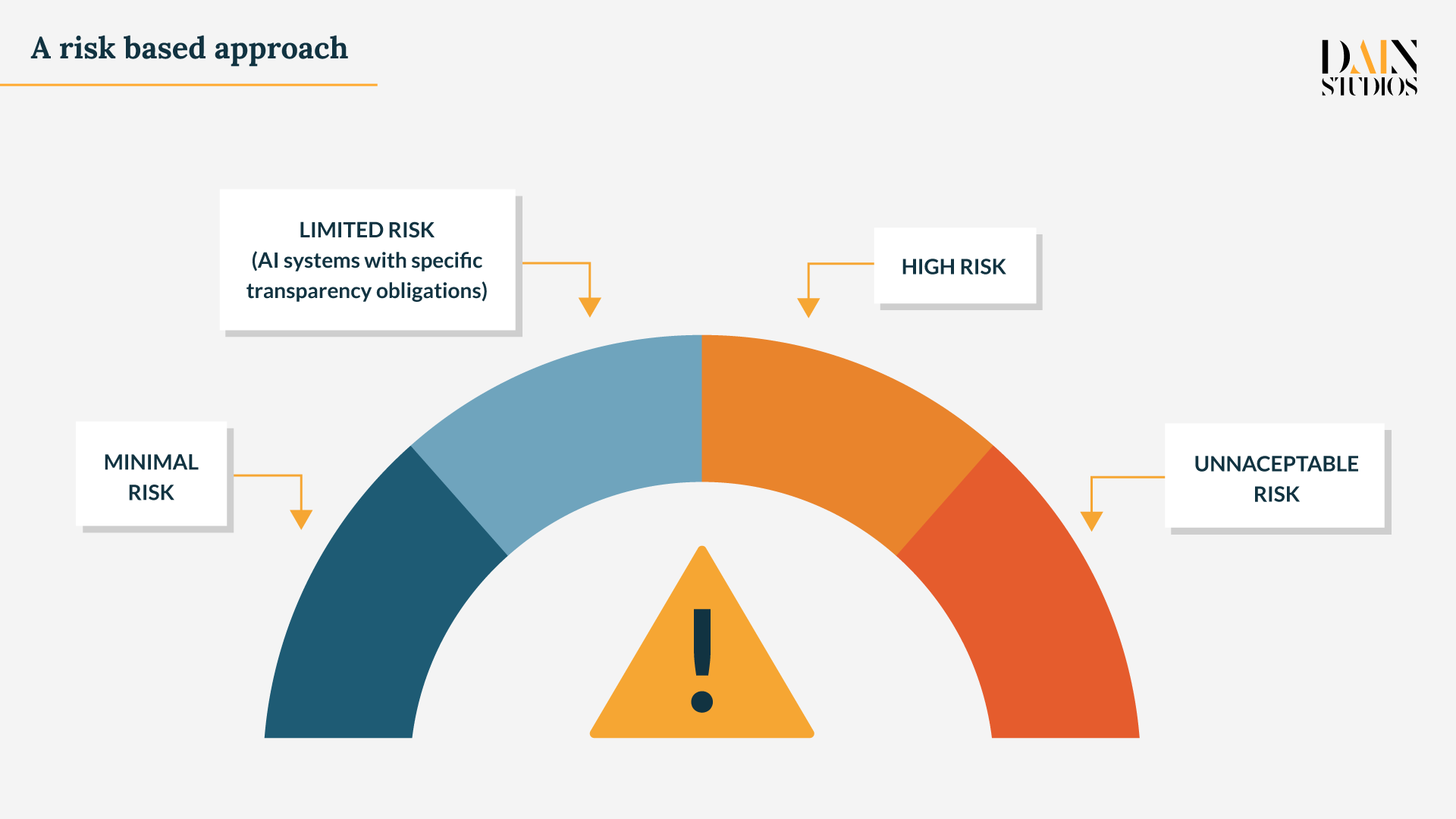

Klar ist, dass das EU-KI-Gesetz einen KI-Produktsicherheitsrahmen schaffen wird, der auf vier Risikokategorien basiert. Chatbots, Spam-Filter, Bestandsmanagement- oder Kundensegmentierungssysteme werden als Anwendungen mit minimalem oder gar keinem Risiko definiert und werden nicht reguliert werden. Im Gegensatz dazu werden KI-gesteuerte Anwendungen zur sozialen Bewertung, zur Manipulation von Verhalten, zur Verursachung körperlicher oder psychischer Schäden oder zur biometrischen Identifizierung von Personen im öffentlichen Raum in Echtzeit als inakzeptabel risikoreich eingestuft und vollständig verboten (obwohl es wahrscheinlich eine umstrittene Ausnahmeregelung geben wird, die die biometrische Identifizierung für bestimmte wichtige Polizeiaufgaben erlaubt).

Zwischen diesen Polen liegen KI-gesteuerte Produkte, die zwar erlaubt sind, aber bestimmten Informations- und Transparenzpflichten unterliegen. Ultrarealistische Bots, die mit Menschen interagieren, Anwendungen, die auf der Grundlage biometrischer Daten Emotionen erkennen oder Assoziationen mit sozialen Kategorien bestimmen, computergenerierte Bilder - sogenannte Deepfake-Fotos, Filmausschnitte oder Tonschnipsel - müssen als KI-Produkte gekennzeichnet werden. Dies ermöglicht es den Nutzern, von der Interaktion mit solchen KI-gestützten Produkten abzusehen, wenn sie nicht möchten, dass ihre Emotionen bewertet werden, oder wenn sie keine teilweise oder vollständig fiktiven Inhalte sehen oder hören möchten.

Und schließlich gibt es KI-gesteuerte Produkte, die als hochriskant, aber zulässig gelten. Sie können den Nutzern nur zur Verfügung gestellt werden, wenn sie nachweislich die EU-Vorschriften für hochriskante KI erfüllen. Lösungen, die biometrische Identifizierung und Kategorisierung nutzen, kritische Infrastrukturen (wie Verkehr und Elektrizität) verwalten, Personal verwalten oder rekrutieren, den Zugang zu privaten Dienstleistungen (wie Bankdarlehen) oder öffentlichen Diensten und Leistungen kontrollieren, bei der Strafverfolgung, Migration, Asyl, Grenzkontrolle und Justizverwaltung helfen, benötigen alle ein CE-Produktsicherheitskennzeichen, bevor sie kommerziell an Nutzer vermarktet werden können.

Das bedeutet, dass KI-Anbieter in den Bereichen Finanzdienstleistungen, Bildung, Beschäftigung und Personalwesen, Strafverfolgung, industrielle KI, medizinische Geräte, Autos, Maschinen und Spielzeug nicht nur nachweisen müssen, dass ihre Produkte die EU-Anforderungen erfüllen, sobald sie auf den Markt kommen. Sie müssen auch nachweisen, dass ihre Trainings-, Test- und Validierungsdatensätze für das maschinelle Lernen den EU-Standards entsprechen, bevor dies überhaupt geschieht. KI muss rechtlich, ethisch und technisch robust sein und gleichzeitig die demokratischen Werte, die Menschenrechte und die Rechtsstaatlichkeit respektieren. Das KI-Gesetz beruht auf der Prämisse, dass die Technologie eine breite Akzeptanz findet, wenn die Nutzer wissen, dass sie der KI vertrauen können.

Zehn neue Compliance-"To-dos" für Entwickler von risikoreicher KI

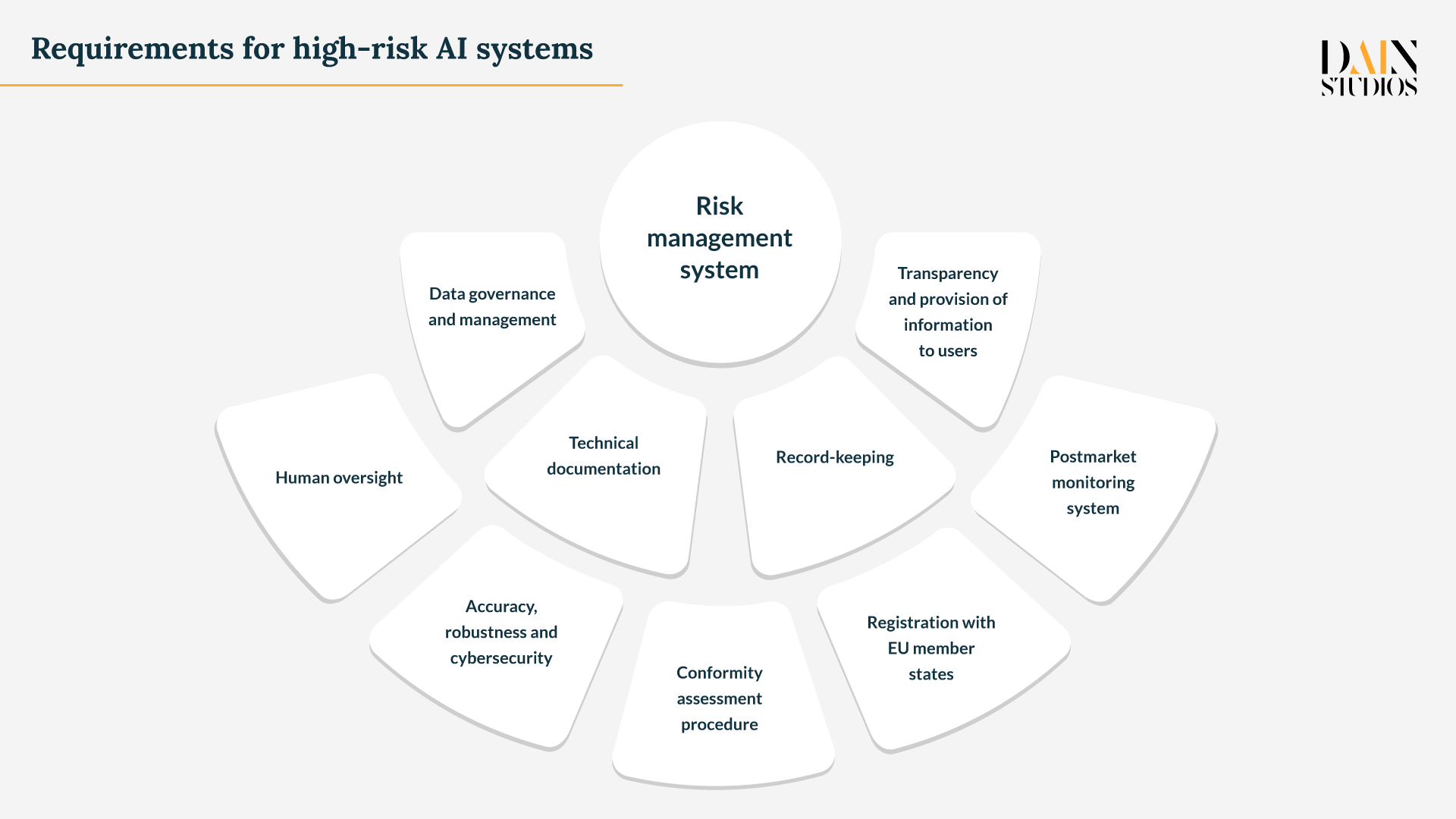

Der vor einem Jahr veröffentlichte Verordnungsentwurf legt die meisten Verpflichtungen in Bezug auf hochriskante KI-Systeme den KI-Anbietern auf - obwohl Händler, Importeure, Nutzer "oder sonstige Dritte" denselben Anforderungen unterliegen, wenn sie ein KI-basiertes Produkt unter ihrem Namen oder ihrer Marke vermarkten oder dessen Zweck ändern oder wesentliche Änderungen vornehmen. Bei der Verordnung handelt es sich um einen Rechtsakt, der automatisch und einheitlich in allen EU-Ländern gelten wird - und die Mitgliedsstaaten werden auch für die Durchsetzung der Vorschriften des KI-Gesetzes verantwortlich sein. Insbesondere müssen Anbieter von KI-gesteuerten Produkten und Systemen mit hohem Risiko diese einführen und aufrechterhalten:

- ein Risikomanagementsystem, das sich mit den Risiken des KI-Systems befasst,

- ein System zur Gewährleistung von Data Governance und Verwaltung,

- technische Unterlagen, beginnend mit einer allgemeinen Beschreibung des Produkts,

- Protokollierung durch automatische Aufzeichnung von Ereignissen,

- Transparenz über die verwendete KI und Bereitstellung von Informationen für die Nutzer,

- eine wirksame menschliche Aufsicht über das KI-System und seine Entscheidungen,

- Genauigkeit, Robustheit und Cybersicherheit des KI-Systems,

- einem Konformitätsbewertungsverfahren unterzogen werden, bevor sie verwendet werden,

- Produktregistrierung in den EU-Mitgliedstaaten durch das CE-Zeichen,

- Überwachung nach dem Inverkehrbringen, um Abhilfemaßnahmen zu ermöglichen, falls die KI nicht konform ist.

Es handelt sich um eine lange Liste, die an einigen Stellen noch sehr vage ist. Der Abschnitt Data Governance und Verwaltung sieht beispielsweise nur vage Qualitätskriterien für Schulungs-, Test- und Validierungsdatensätze vor - sie sollten "geeigneten Data Governance und Verwaltungspraktiken" unterliegen. Andererseits sind Anforderungen wie das Verstehen von Risiken und die Kommunikation von Algorithmen bereits Teil der Allgemeinen Datenschutzverordnung (GDPR) der EU, die 2018 in Kraft getreten ist. KI-Anbieter müssen eine Beschreibung des KI-Systems geben, einschließlich des beabsichtigten Zwecks, der Personen, die es entwickeln, und wie es mit anderer Hardware oder Software interagiert.

Die bahnbrechende GDPR ist in vielerlei Hinsicht ein wichtiger Präzedenzfall für das KI-Gesetz. Softwareentwickler haben gelernt, die EU-Datenschutzvorschriften in ihre Arbeit einzubeziehen - und es gibt allen Grund zu der Annahme, dass sie dies auch bei der KI-Verordnung tun werden. Hier wie dort werden die Vorschriften die Kosten für einige Akteure erhöhen, aber auch neue Möglichkeiten für Unternehmen schaffen, die Compliance-Dienste anbieten. Schließlich kodifiziert das KI-Gesetz viele bewährte Praktiken, die bereits im Einsatz sind (und die jeder anwenden sollte). Transparenz und "Erklärbarkeit" sind von entscheidender Bedeutung, um die Ängste der Öffentlichkeit vor KI zu bekämpfen, und nichts weniger als eine Voraussetzung dafür, dass die Branche im Geschäft bleibt.

Bußgelder bei Nichteinhaltung - und die Kosten für die Einhaltung der Vorschriften

Die Sanktionen des AI-Gesetzes bei Nichteinhaltung sind aus der Datenschutz-Grundverordnung bekannt. Unternehmen können mit einer Geldstrafe belegt werden:

- bis zu 10 Mio. € oder 2 % des weltweiten Jahresumsatzes (je nachdem, welcher Betrag höher ist) bei unrichtigen, unvollständigen oder irreführenden Angaben auf Anfrage der Behörden,

- bis zu 20 Mio. € oder 4 % bei Nichteinhaltung der meisten Anforderungen oder Verpflichtungen,

- bis zu 30 Mio. € bzw. 6 % bei Verstößen oder Nichteinhaltung der Datenanforderungen.

Was die Kostenseite anbelangt, so hat die Kommission in ihrer Folgenabschätzung für das Jahr 2021 vorgeschlagen, dass die Kosten für die Einhaltung der Vorschriften für KI mit hohem Risiko ähnlich hoch sein könnten wie die Kosten für die Umsetzung der Datenschutz-Grundverordnung - mit dem Vorbehalt, dass die Kosten für die Einhaltung des KI-Gesetzes zum Teil wiederkehrend sind, da jedes KI-System überwacht (und möglicherweise angepasst und dann auf seine Konformität überprüft) werden muss. Die Studie schätzt, dass sich die Kosten für die Einhaltung der Vorschriften auf 4-5 Prozent der Softwarekosten belaufen würden, wobei sich die Gesamtkosten für KI-Anwendungen mit hohem Risiko im Jahr 2025 auf 100 bis 500 Millionen Euro belaufen könnten. Daraus ergibt sich, dass eine Branche, die sich mit den Belastungen der DSGVO auseinandergesetzt hat, auch die Kosten des KI-Gesetzes überstehen wird.

Der Verordnungsentwurf der Kommission enthält jedoch einige Vorbehalte für KMU und Start-ups. So werden die EU-Mitgliedstaaten verpflichtet, kleinen Anbietern und Start-ups vorrangigen Zugang zu KI-Regulierungs-Sandkästen zu gewähren und die Interessen und Bedürfnisse kleiner Anbieter bei der Festlegung der Konformitätsbewertungsgebühren zu berücksichtigen. Darüber hinaus werden die nationalen Behörden aufgefordert, bei der Festsetzung von Sanktionen "insbesondere die Interessen kleiner Anbieter und Start-ups sowie deren wirtschaftliche Lebensfähigkeit zu berücksichtigen". Da das KI-Gesetz auch dazu dienen soll, KI-Investitionen zu fördern, wird es interessant sein zu sehen, wie es letztlich kleinere Akteure behandelt.

Eine der wichtigsten Botschaften des KI-Gesetzes ist, dass KI-Systeme nicht absichtlich böswillig sind - aber dass sie aufgrund ihrer traditionellen Intransparenz und ihres ständig wachsenden Umfangs enorme direkte und indirekte negative Auswirkungen auf die Umgebungen haben können, in denen sie arbeiten. Die KI-Branche muss sich dieses Problems bewusst sein, Standards festlegen, um dem entgegenzuwirken, und an der Regulierung arbeiten. Und wenn das KI-Gesetz der EU ihr auf diesem Weg helfen kann, sollte sich die Branche konstruktiv mit ihm auseinandersetzen. Für die EU wird die Kunst darin bestehen, eine Regulierung einzuführen, die das Vertrauen in die Branche als Ganzes stärkt, ohne die großen gegenüber den kleinen Akteuren zu privilegieren.